Ровно год назад, 18 марта 2018, в американском городке Темпе, штат Аризона, произошла автомобильная авария со смертельным исходом. Вечером того дня такси Uber сбило переходившую дорогу 49-летнюю Элейн Херцберг, которая впоследствии скончалась в больнице от полученных травм. Вряд ли этот трагический инцидент привлек бы большое внимание – в Америке ежегодно в автокатастрофах погибают более 35 тысяч человек, если бы не одно обстоятельство. За рулем внедорожника Volvo XC90 находилась водитель-дублер, 44-летняя Рафаэла Васкес, и на момент столкновения автомобиль уже 19 минут как двигался на автопилоте в автономном режиме. Таким образом, Элейн Херцберг — первая жертва беспилотного автомобиля.

Первой жертвой обычного автомобиля считается некая Бриджит Дрисколл, которая была сбита 17 августа 1896 года в Лондоне. По словам свидетелей, машина мчалась со страшной скоростью, около восьми километров в час, и бедная женщина тщетно пыталась защититься своим зонтиком от несущейся на нее безлошадной повозки.

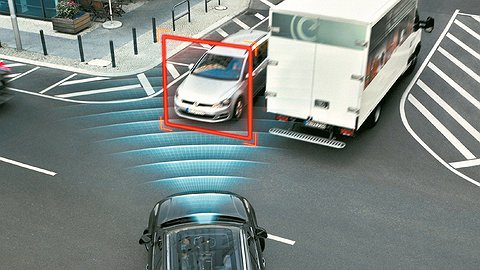

Несколько смертельных ДТП с участием систем автоматизированного управления автомобилем имели место и раньше. Все они касались моделей Tesla. Однако, там были системы, которые только помогают водителю управлять транспортным средством. По классификации Международного сообщества автомобильных инженеров (SAE) это “системы второго уровня”. Всего таких уровней пять. В случае с Uber речь идет о системе третьего уровня, когда автомобиль едет самостоятельно, но предполагается периодическое вмешательство человека в процесс управления.

Вскоре стали появляться подробности. В крови Рафаэлы Васкес обнаружили метамфетамин и марихуану. И вообще оказалось, что Рафаэла еще не так давно была мужчиной Рафаэлем, в 2001 году получившим пять лет (отсидел четыре) за вооруженное ограбление. А погибшая Элейн Херцберг оказалась бездомной, которая со своим велосипедом переходила дорогу «небезопасным способом». То есть, переходить в том месте можно, но в вечернее время рекомендуется пользоваться специальными хорошо освещенными переходами. Согласно предварительным выводам полиции «столкновение было неизбежно». По словам водителя, женщина «возникла совершенно внезапно». Впрочем, при изучении записей автомобильных камер выяснилось, что в момент столкновения Рафаэла смотрела американское шоу «Голос» на своем смартфоне. Телеметрические датчики показали, что она попыталась отвернуть руль менее, чем за секунду до столкновения. А на тормоза нажала уже через секунду после наезда.

На основании данных телеметрии и записей камер наружного наблюдения специалисты из Национального совета по безопасности на транспорте подтвердили, что автомобиль двигался с превышением скорости; поначалу озвучивались противоречивые данные. Но даже при этом, появление Элейн Херцберг было зафиксировано за шесть секунд до столкновения, и при таких дорожных условиях автопилот должен был успеть среагировать и предотвратить наезд.

Что общего у Uber и голема

О том, что у Uber есть проблемы с безопасностью было известно и раньше. Как раз за неделю до инцидента Робби Миллер, руководитель отдела беспилотного тестирования сообщил, что он уходит из компании, отметив, что «автомобили постоянно попадают в ситуации, когда они причиняют ущерб». В феврале инциденты случались практически каждый день, по одному на каждые 15 тысяч миль общего пробега. Особое внимание Миллер обратил на квалификацию водителей и их подготовку. Выяснилось также, что у компании слишком «теплые отношения» с властями штата Аризона, которые активно продвигали «недостаточно надежные технологии». Речь даже шла о том, что на предварительное следствие могло оказываться определенное давление. Поэтому из-за конфликта интересов дело было передано из округа Марикопа, где находится Темпе, в соседний Явапаи. А Uber свернул деятельность в Аризоне до выяснения всех обстоятельств, что, впрочем, обычная практика.

За всеми этими увлекательными подробностями на задний план незаметно отошли другие, на самом деле, очень серьёзные вопросы. Во-первых, вопрос юридической ответственности при эксплуатации беспилотных автомобилей и шире, за решения, принимаемые искусственным интеллектом. Раньше ответственность несли водитель, страховая компания и непосредственно автопроизводитель. Теперь иск напрямую можно предъявлять компании, которая оборудует автомобиль системой автопилотирования. И даже непосредственно производителю самой технологии автоматического управления, то есть разработчику программного обеспечения. Юридический подход, несколько опережая жизнь, заранее поддерживает логику бизнеса. Так всегда было в IT: в какой-то момент софт, как таковой, «отвязался» от железа. Затем операционные системы стали «отвязываться» от аппаратных платформ. От самих операционных систем стало «отвязываться» прикладное программное обеспечение. Данные становятся все меньше «привязаны» к пользовательским устройствам. А пользователи, если и «привязаны» к своим устройствам, то, скорее, эмоционально, чем технически.

Впрочем, во всех странах с законодательным регулированием искусственного интеллекта вопросов пока больше, чем ответов. Мы пытаемся найти баланс между такими заманчивыми перспективами, которые открывают нам новые технологии, и социальными институтами, которые обеспечивают само наше существование. И при этом, даже не очень пока понимаем, с чем мы имеем дело. В 2016 году Комитет Европарламента по юридическим вопросам подготовил проект предложений по гражданско-правовому регулированию в сфере робототехники. Вводная мотивировочная часть этого серьезного юридического документа содержит отсылки к мифу о Пигмалионе, чудовищу Франкенштейна, легенде о пражском големе и роботам Чапека.

Роботы в законе

В 1920 году начинающий, но уже довольно известный автор Карел Чапек написал научно-фантастическую пьесу «Россумские универсальные роботы». Поначалу он собирался назвать своих искусственных людей на латинский манер «лаборерами». Но старший брат Йозеф предложил назвать их «роботами» от чешского слова robota – «принудительный труд». Пьеса была переведена на английский и с успехом шла в Америке, где критика назвала ее «весьма оригинальным триллером». Благодаря Чапеку английский язык, и через него уже все остальные, обогатился словом «робот». Правда, английский долго еще не мог «прожевать» славянский корень, превращая его то в «роубоута», то в «рабата» и экспериментируя, куда лучше поставить ударение; современное произношение устоялось много позже.

Чапека интересовала, прежде всего, социальная этика: допустима ли эксплуатация искусственных людей? В том, что со временем такие искусственные люди появятся, и что это будет именно эксплуатация, он не сомневался.

А вот Айзек Азимов считал, что пьеса очень слабая. В 1942 году он опубликовал рассказ «Хоровод», где предложил свои знаменитые «три закона робототехники».

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

Это его ответ Чапеку и попытка перенести проблему из плоскости социальной ответственности людей в область индивидуальной ответственности искусственного разума. И, как пишет шведский философ Ник Бостром, профессор Оксфордского университета и крупнейший теоретик трансгуманизма: «К стыду нашего вида, эти правила оставались неизменными более полувека, несмотря на очевиднейшие пробелы, которые, кстати, видел и сам Азимов… Наверное писатель специально изложил законы в таком расплывчатом виде, оставив для себя и своих героев шанскаждый раз трактовать их несколько иначе, а заодно и нарушать разными занимательными способами.»

В 2016 году в России юридическая фирма Dentons по заказу Дмитрия Гришина, основателя компании Grishin Robotics, разработала концепцию законопроекта о робототехнике. Утверждалось, что это первая в мире подобная концепция, что не совсем так. Впрочем, сама концепция интересная. Робота предлагается рассматривать одновременно и как животное, и как юридическое лицо. С одной стороны, роботы схожи с животными, поскольку способны совершать автономные действия. С другой стороны, авторы концепции полагают, что отсутствие эмоций не позволяет сделать роботов субъектами права и предлагают считать их «особой юридической конструкцией». Хотя вообще-то, физическое лицо тоже не объект мира, но субъект права. И юридическое лицо, конечно, субъект, хотя и очень спорно, какие эмоции на юридическом лице.

Еще в I веке до нашей эры Марк Теренций Варрон в «Трактате о сельском хозяйстве» писал, что существует три вида орудий труда. Во-первых, неодушевленные, например, мотыга. Во-вторых, одушевленные, издающие нечленораздельные звуки — это скот. И, наконец, в-третьих, одушевленные и говорящие, то есть рабы. За эти слова наблюдательный ученый и тонкий стилист Варрон был заклеймен последующими поколениями моралистов. А ведь он просто размышлял о регулировании имущественных отношений. И в имущественном плане робот, как раз, находится в состоянии рабства, в полном соответствии с соответствующей «Конвенцией о рабстве» Лиги Наций от 1926 года. Пока Европарламент просто предложил систему обязательного страхования возможного ущерба, который робот может причинить здоровью людей или их имуществу. Тоже логично: хозяева всегда несли ответственность за действия своих рабов.

Но проблемы не только в сфере имущественных отношений. Как бы ни отмахивались инженеры от вопросов этики, эти вопросы никуда не денутся. В Америке, кстати, даже есть Комиссия по этике систем автоматического вождения. В августе 2017 года она опубликовала отчет, вызвавший довольно бурную, хотя и не очень продолжительную, дискуссию. Из отчета многие сделали для себя удивительное открытие: оказывается, не существует всеобщей морали. По результатам опроса респондентов в 130 странах, авторы выделили три кластера этических предпочтений. Все это вариации на тему известной «проблемы вагонетки». Этот популярный мысленный эксперимент был предложен еще в 1967 году английским философом Филиппой Фут: «Неуправляемая вагонетка несется по рельсам. На ее пути привязаны пять человек. Вы можете переключить стрелку, и тогда вагонетка поедет по другой ветке. Но там тоже привязан один человек. Времени нет, но есть два варианта действий: не делать ничего и допустить гибель пяти человек, или убить одного и спасти этих пятерых.» Позднее появились различные варианты, усложняющие базовый сценарий, но суть от этого не меняется.

Изначально предполагалось, что предпочтения людей не должны зависеть от демографических и культурных факторов. То есть, в своих действиях мы все руководствуемся некоей «универсальной моральной грамматикой» — идея, восходящая еще к универсальному языку Бэкона, Декарта и Лейбница и к универсальной грамматике Хомского. Однако, оказалось, что все совсем не так. В различных исследованиях было установлено, что и возраст, и пол, и культура имеют огромное значение. Так что в случае моральной дилеммы, например, давить пожилую пару или женщину с коляской, решение сильно зависит, в том числе, и от страны, где происходит дело. С технической точки зрения, все это — вопрос локализации продукта. И, например, для индийского автопилота нужно просто проработать варианты потенциального наезда на представителей различных каст, а также коров. На сайте Массачусетского технологического института есть проект, где можно поиграть с интерактивными сценариями различных ДТП, в которых возникают вопросы морального выбора. И даже предложить свой сценарий. Но стоит помнить, что у «проблемы вагонетки» нет логического (не путать с логичным) решения, зато она, как правило, вызывает серьезный когнитивно-эмоциональный конфликт. Так уж мы устроены.

А жизнь идет своим чередом. 5 марта прокуратура округа Явапаи, куда было передано дело, описанное в начале этой статьи, пришла к заключению:«не имеется оснований для привлечения к уголовной ответственности компании Uber». То есть разработчик технологии беспилотного вождения в данном случае ответственности не несет. У этого вердикта будут далеко идущие последствия. Собственно, они были бы такими при любом решении. Но пока Uber может перевести дух. И вот уже буквально через неделю стало известно, что совместные работы с компанией Тойота, приостановленные сразу же после инцидента, продолжатся. А крупнейший японский телекоммуникационный конгломерат SoftBank Group (точнее, его инвестиционное подразделение Softbank Vision Fund), по-видимому, вложит около миллиарда долларов в подразделение Uber, занимающееся технологиями автопилотирования.

А нам просто нужно привыкать к мысли, что наезд может совершить не только естественный, но и искусственный интеллект. А если это сильно ранит чье-то человеческое достоинство, то можно утешать себя мыслью, что искусственный, по крайней мере, не пьет за рулем.